文|中外管理传媒 王爽

前不久,欧洲议会、欧盟成员国和欧盟委员会三方就《人工智能法案》达成协议,这被认为是全球首个全面监管人工智能(AI)的法案。在经过长达36个小时的马拉松式谈判后,欧洲议会、欧盟成员国和欧盟委员会于12月8日晚就《人工智能法案》达成协议。

根据欧洲议会的声明,达成的协议包括禁止几种AI应用程序,例如无目标地抓取图像以创建面部识别库,并为立法者认定的高风险系统制定规则。而未能遵守新法规的公司将面临最高相当于全球营业额7%的罚款。

人类对人工智能的担忧,似乎从它诞生之日起就存在。此前,人工智能领域的全球领导者OpenAI突发的管理层震动,正是这些离技术最近的人,对技术发展的担忧。人工智能是否应该蒙眼狂奔,还是以安全性为首要考量放慢速度?在两种观点的冲突之下,OpenAI此前上演了一场精彩的“宫斗大戏”。简单回顾一下事情经过:

11月17日,OpenAI联合创始人兼CEO山姆·奥特曼突然被公司董事会宣布“毕业”。

11月19日,奥特曼“第一次也是最后一次”,戴着访客牌到OpenAI与董事会洽谈。但是董事会未能同意他复职的拟议条款,而是找到了一位临时CEO。

11月20日,微软CEO萨蒂亚·纳德拉宣布,刚刚被解雇的奥特曼将加入微软,共同服务一个新的先进人工智能研究团队,微软为他们提供成功所需的资源。

11月21日,Open AI发布声明,奥特曼回归OpenAI。

当时,关于OpenAI 的大戏一波未平一波又起,反转反转再反转。随着奥特曼的回归,OpenAI跌宕起伏的剧情看似已经大结局,但事实上还留下诸多的未知数。为何董事会坚持要让奥特曼离开?董事会到底有什么证据或是理由,不顾九成内部员工抗议强行辞退奥特曼,至今其中的缘由都没有被公开。

站在十字路口,在理想与现实的角逐中,人工智能技术会走向何方?

安全向左,技术向右

根据此前路透社发布的消息,奥特曼的辞退闹剧很可能源于一封来自OpenAI员工的匿名信件。信中提到,OpenAI最新研发的新型人工智能大模型“Q-star”取得了突破性进展,人工智能拥有了解决数学问题的能力。研究人员认为,当人工智能掌握了只有唯一正确答案的数学运算,这就意味着人工智能将具备更接近人类的推理能力。与只能执行有限运算的计算器不同,人工智能如果能够进行泛化学习和理解,就可以独自解答完全陌生的数学题目。就像人类通过学习数学课本上的例题之后,会自己做题一样。这意味着,人工智能可以在最具经济价值的任务中超越人类的自主系统,而这可能对人类产生威胁。

这封警告信,或许正是董事会严厉指责“奥特曼对董事会不坦诚”,并解雇奥特曼的导火线之一。

这次解雇风波的发起人,OpenAI首席科学家伊利亚·萨克斯维尔,是OpenAI董事会中绝对意义上的技术担当。

在一部纪录片中,面对镜头,伊利亚对人工智能技术的发展无比乐观,认为OpenAI正在创造的是一个具有独立资格、完全自主的存在。但是在片子结尾,他不无担忧地说:“未来对人工智能而言是美好的,如果对人类来说也是如此就好了。”出于审慎态度,此前伊利亚还专门成立了一个团队研究,如何防止人工智能系统运行异常。

从ChatGPT横空出世,到被普遍认为相当无敌的GPT4问世,大模型的进步肉眼可见,此前OpenAI更是高调地推进技术落地。但奥特曼越亢奋,伊利亚就越焦虑,对他来说OpenAI的激进做法,似乎离最初用人工智能造福人类的信仰越来越远。

条条大路通罗马,但通往人工智能造福人类的路到底选哪条?奥特曼选择全速前进,而伊利亚显然更加关注人工智能的安全性。激进的技术路线是否会有隐患?这是伊利亚的担忧,也是他要“赶”奥特曼离开的底层动机。

独特架构能“管”住OpenAI?

2014年,谷歌以6亿美元的价格收购了当时业内最顶尖的人工智能研究机构DeepMind,之后推出了惊艳世人的AlphaGo。对此,一些人工智能领域中坚人士看到了人工智能的潜力和威胁,他们害怕谷歌会成为垄断人工智能的权力霸主。其中6位来自硅谷的科技梦想家聚在一起,决定成立一家不受任何公司、任何资本、任何人控制的人工智能实验室,希望探索出一条以安全方式构建人工智能的正确路径。

2015年底,非营利组织OpenAI正式成立。其目标明确而又雄心勃勃:开发能够造福全人类的“通用人工智能”。初期,OpenAI完全依靠捐赠维持组织运转,并承诺向公众开放其专利和研究。这是OpenAI的起点与初心,可是这个非常理想主义、非常“乌托邦”的组织,很快遇到了“经济危机”。

2018年,OpenAI的创始人之一和“大金主”埃隆·马斯克宣布退出董事会。在马斯克离开之后,他尚未兑现的捐赠,将OpenAI一下推到了一个非常不利的境地。

彼时OpenAI的艰难处境让奥特曼对非营利组织的模式产生了动摇,转而探索更现实的商业路线。

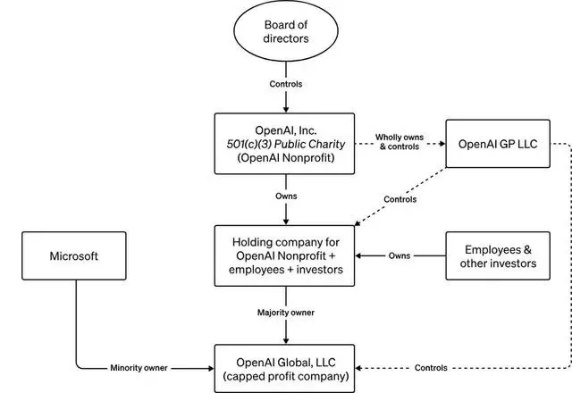

于是,一个全新的公司架构出现了:

在母公司OpenAI Inc.的非营利主体之下,创建一个限制性盈利实体OpenAI LP。OpenAI Inc.的控制权归属于OpenAI非营利组织的董事会,董事会作为OpenAI LP的一般合伙人,全权管理着OpenAI LP,负责引导OpenAI LP的运营。在有限合伙制度下,一般合伙人具有对企业的完全管理和控制权,同时也需要承担无限责任。

同时,OpenAI LP的有限合伙人群体中,包含了OpenAI LP的员工、部分董事会成员,以及Reid Hoffman慈善基金、Khosla Ventures等其他投资者。理论上,他们的责任仅限于其投资额。有限合伙人可以获得分红,但从OpenAI LP所得的最高收益被限制在他们投资额的100倍。

此后,公司又在OpenAI LP之下又设立了OpenAI Global,OpenAI LP和大投资方微软分享股权,并以分红的形式,分享OpenAI的商业成果。其中,OpenAI LP占股51%,微软占49%。

在这套架构里,拥有和控制是两个完全不同的概念。不论是非营利组织资产平台还是限制性营利公司,他们的决策权都掌握在一个非营利组织全资拥有并控制的管理实体手中。而这个管理实体的权利来源还是来自于非营利组织的董事会。其实简单来说就是,拿钱的不能投票,投票的不能拿钱。所以,最大的出资方微软,愣是被排除在了OpenAI的决策层之外。

在这个“权”“利”分家的组织架构下,OpenAI LP能够放开手脚“搞钱”,微软等投资方能够从投资中获得收益,董事会也能独立于资方,保持对整个公司掌控,保证大船不偏航。站在当时的角度看,这确实是一个巧妙符合了存在主义和理想主义的完美方案,避免公司受到资本的侵蚀。

可是当时堪称“完美”的组织架构,为OpenAI的风波埋下了伏笔。它独特的架构设计不仅仅是挑战人性,甚至可以说是反人性的。在OpenAI的逻辑下,公司有挣钱的能力却不好好挣钱,仅靠理想信念支撑、用爱发电,这样的技术“圣徒”有多少人?这样的“朝圣路”又能走多远?

从某种程度上来说,OpenAI的风波是其发展史上难以略过的节点性时刻,它充分表明:乌托邦里,容不下“世俗”的欲望。或者说,“钞能力”足以撼动理想。

在舆论场中,不少人在情感上站在了伊利亚一边,认为OpenAI风波的背后是科学家创始人奋力抵抗的悲歌。这场风波被遐想为,资本家只顾着逐利,科学家则心存良知。但不能忘记的是,OpenAI要实现理想主义,前提条件是要活着不断探索。而开发人工智能本身就是一件耗钱、耗资源、耗算力又耗时间的事情,离开资本支持,OpenAI根本玩不转。在奥特曼精心设计的独裁帝国里,资本没有举手议政的权利,但有用脚投票的自由。名义上OpenAI所有决定都必须经过董事会点头,但不持股的董事会面对花了真金白银支撑OpenAI的资本,话语权其实十分有限。

其实,从资本的角度来看,全力加速技术的发展和商业化无可厚非。同样,从安全角度考量,审慎地进行技术推进更没有错。OpenAI的这场风波,与其说是理想与现实的冲突,不如说是旧制度与新形势的矛盾。此前,面对生存危机,奥特曼激进的改革措施,不仅被允许甚至被董事会鼓励。但如今已生存无忧的OpenAI,还需要冒着危害人类安全的风险继续冒进吗?还要不要坚持创业初期的“战时体制”?这大概才是出现OpenAI风波的症结点。

而要不要冒着风险快速发展,也是如今越来越多人对人工智能的质疑。甚至,以审慎的态度发展人工智能成为越来越多人的共识。

让技术的子弹飞一会儿

在人工智能的研发初期,你很难找到反对发展这项技术的论据,但随着人工智能的演进,它的阴暗面逐渐显现。自然语言处理和机器学习被用于社交媒体、搜索和推荐引擎,扩大了信息的两极分化、偏见和错误。

甚至,“速度与安全”并不是唯一让人工智能领域的专家们感到威胁的问题。更多的人在担忧另一件更棘手的事情:人工智能正在操纵人类,人工智能将发挥更难以想象的巨大力量来操纵人类的无意识。

OpenAI风波之前,伊利亚和相关负责人共同领导了一个“超级对齐”研究项目,该项目致力于解决一个简单但极其复杂的问题:“如何确保人工智能系统比人类更聪明地遵循人类的目标?”

但问题是,人工智能该与什么样的人类目标保持一致?OpenAI的一系列风波充分证明了,即使是极少数OpenAI领导者之间的目标也是不可能一致的。

面对注定相互冲突的目标,放缓人工智能的研究,让技术的子弹飞一会儿,或许是一种解题思路。

在超越人类智慧的人工智能这条“恶龙”真正出笼之前,每个人都认为自己有资格驾驭它。但无论是“奥特曼”还是“伊利亚”,谁都无法笃定地说,自己选择了正确的道路。毕竟,“人类的判断总会受限,真理只能在不断延续中显现。”

评论