文丨智驾时代 元霸

编辑丨浪浪山与明知山

2024年初始,智驾车企或明或暗开启了一轮“城市NOA全国都能开”的激烈竞赛。

头部车企大多选择了用“去图”去应对全国都能开,年底前华为、小鹏、极越、理想等车企都基本摆脱了对“高精地图”的依赖,部分或全量推送给用户体验相关去图智驾版本。

“去图”化(去高精地图化)的背后是车端感知能力和AI端到端智驾技术带来的云端大模型算法、算力和车端理解能力的增强。而更重要的是,随着数据量的加大,端到端智驾系统对复杂路况的理解、分析能力正突破临界点。

如果说,“去图”是今年智驾比拼最重要的一条赛道,AI端到端同时带来了另一条赛道的突破,也就是“去激光雷达”的视觉智驾正日益展示出应对复杂路况的成熟能力。

今天,马斯克再次在社交媒体上表示激光雷达是错误的解决方案,并强调纯视觉智驾就是复杂道路自动驾驶最有效的方案。

如果说马斯克的话只能代表他的观点,那么纯视觉智驾在中国复杂道路上的表现,则更有发言权。

在近期的“中国智驾大赛”中,极越01和小鹏P7+作为唯二的纯视觉车型,与华为系、蔚来、理想一众激光雷达车型同场竞技,表现也是可圈可点。

上周的分站赛,场地选在没有高精地图覆盖的中山,考验的是智驾系统“无图全国都能开”的能力。

拥有AI端到端智驾的极越01作为比赛中唯一选用纯视觉路线的车型,以小比分差距获得季军。

从榜单来看,极越01与前两名小鹏G6(101.64)、理想L7 (101.41)的比分咬得很紧。此外,极越在13个分项中拿到了8个满分。相比之下,总分第一的小鹏G6则获得了6个满分,而与搭载了鸿蒙智行系统的问界M7、阿维塔11、智界S7三款激光雷达车型相比,极越01也占有分数上的优势。

综合统计,纯视觉的领军极越01在10个城市的战绩是4个冠军1个亚军,1个季军,成绩名列前茅;小鹏P7+是仅在半个月参与了一站珠海站获得了一个第四名,中山站未参赛。

既然极越的表现如此亮眼,是不是意味着纯视觉智驾的春天来了呢?

智驾网认为,由于各家车企的技术路线不尽相同,纯视觉智驾与雷视融合方案(依赖激光雷达的多传感器融合方案)在较长一段时间内会同时存在。

但是,端到端纯视觉智驾正展示出愈来愈强大的处理复杂场景的能力,同时在成本、技术稳定性与开发难度上全方位地超越雷视融合方案。

激光雷达做为一种感知冗余配置的地位更为明确,需要借助激光雷达处理的Corner Case的比例越来越少。

今年,随着AI大模型的兴起,不论是技术迭代、数据闭环、能力成长、用户体验等方面,纯视觉都展示出了巨大优势,甚至可以说,纯视觉已经成为一个趋势。

同时,纯视觉路线的追随者确实也越来越多,目前All IN视觉智驾的主机厂以特斯拉、极越、小鹏汽车为代表,而乐道L60、深蓝S07、智界S7、新问界M5 等鸿蒙智行系车型也在2024年陆续加入了视觉智驾路线。

在国内汽车市场,极越汽车最早站队纯视觉路线,早在2023年初就开启了相关布局,并在2023年10月极越01上市时量产了纯视觉高阶智驾。

从供应商的角度看,这一阵营则更为庞大,华为乾崑、百度阿波罗、卓驭(大疆车载)、大陆智驾、商汤绝影、智驾科技MAXIEYE、Nullmax都是视觉感知智驾技术的供应商,而百度阿波罗、商汤绝影、卓驭都认为视觉智驾就是最终路线。

激光雷达和高精地图在业内曾被称为智驾系统的两大“支柱”,它们会在2024年底被行业抛弃,与马斯克的判断达成一致吗?

我们先来梳理一下,纯视觉智驾路线在即将过去的2024年经历了怎样的发展。 首先,视觉感知的水平在显著提升。

在传统认知里,摄像头相比激光雷达应对阴暗、逆光、静态物等场景的能力不足,在沙尘、雨雪等极端天气下也有短板。

伴随技术的发展,摄像头能力的不足如今可以通过技术加持和新思路提升感知能力,并且即便视觉感知出错,大模型也可以在短时间内进行修正。

比如:小鹏汽车的AI鹰眼视觉智驾方案引入了LOFIC架构大大提升了摄像头的全场景感知能力。这项技术的诞生是为了满足CMOS图像传感器对高动态范围的需求。在逆光、大光差、暗光等环境下的信息采集能力更强。并且该架构方案的视觉感知范围也更大,达到了1.8个标准足球场,甚至能够清晰分辨颜色、文字等语义信息。

▲图片来自:3d tof的《HDR技术详细解析》

而作为国内号称“特斯拉FSD平替”的极越ASD,则用大模型大幅提升了视觉算法能力。因为使用了短距“匕首”、中距离“手枪”、长距离“狙击枪”等视觉大模型,极越ASD的视觉感知3D精度可达到厘米级,超越主流激光雷达。

据称,ASD对运动障碍物速度的识别精度也控制在0.1米/秒误差范围内,大幅提升对于栅栏、护栏、水马和施工隔离栏等有一定长度的通用障碍物的边界识别能力,并通过减速、刹停或者绕行等动作完成避障,留出更多安全距离,绕障丝滑程度就像赛车手一样“脑直觉”。

更重要的是,ASD不仅可以识别200米内矿泉水瓶,还能分辨绿植,预判行人的运动轨迹,即使在雨雪、雾霾或者在夜晚、隧道等光线不足的环境中,依然可以准确地感知和识别。

百度智驾负责人王亮曾表示,ASD使用的大模型与百度萝卜快跑同源,即Apollo L4级自动驾驶的大模型Apollo ADFM(Autonomous Driving Foundation Model)。ADFM可以兼顾技术的安全性和泛化性,安全性数倍于人类驾驶员,而且覆盖了几乎全部复杂场景。

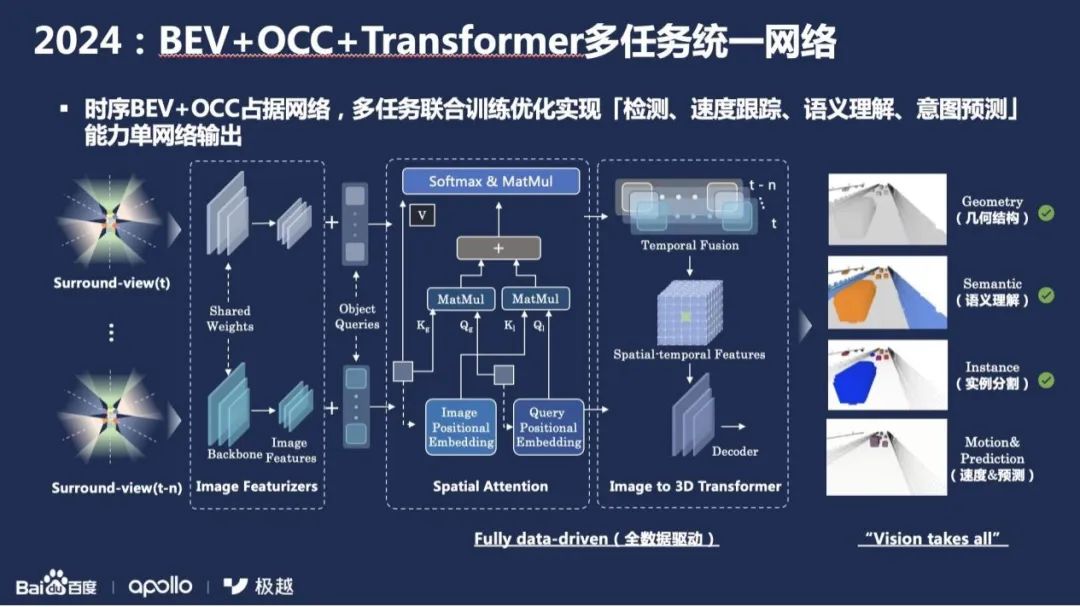

可以说,经过2023年的BEV+Transformer+OCC技术跃升,以及2024年大模型加持,视觉感知能力已经远远超越了激光雷达,同时拥有时间+空间的理解能力,在遇到复杂的Corner Case,大模型理解能力的提升甚至可以修正传感器的错误。

大模型技术正在重构自动驾驶。

虽说两种技术路线会并存,但激光雷达的缺点绝对不容忽视。

很多人都同意王亮的判断,就是激光雷达做为精密仪器,移动部件会降低其可靠性,其能力可以被毫米波雷达和超声波雷达分解替代,同时“伪影”问题会对系统造成巨大的干扰,消除“伪影“的处理复杂度极高。

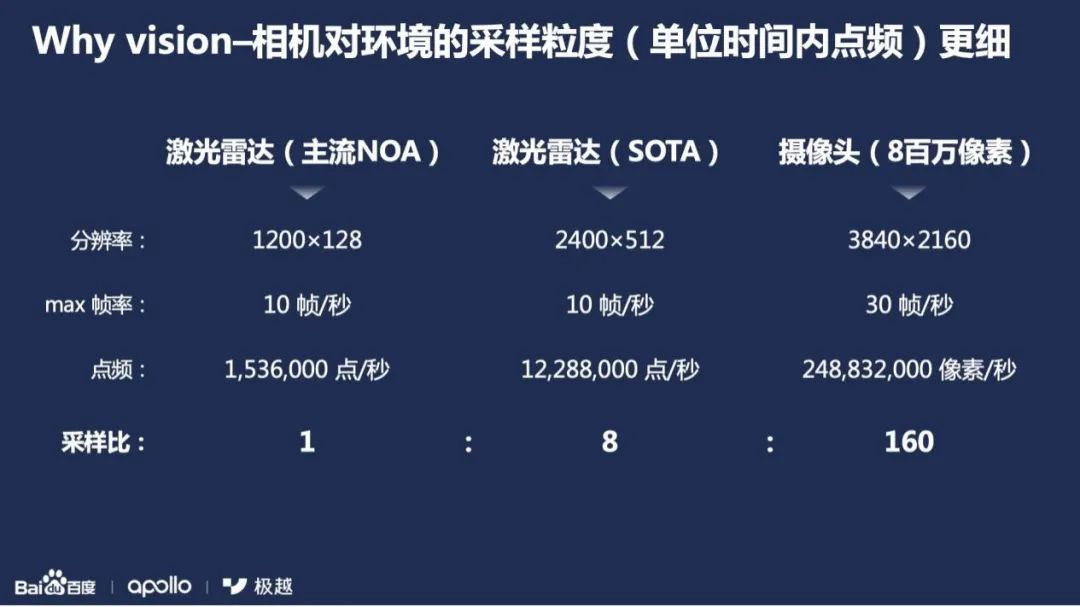

此外,目前车载量产激光雷达的感知数据量依然太少,几乎是摄像头的160分之一。而且激光雷达点云数据还缺少色彩、纹理等关键信息,无法让车辆用这些数据去推测环境意图。

以下图为例,左侧的激光点云无法准确识别物体,而右侧的摄像头图片可以准确分辨出红色交通灯、斑马线以及正在通行的行人和外卖车辆。

某智驾公司工程师曾向智驾网表示,视觉感知路线不仅省掉了激光雷达的成本,在决策效率上也要更快,因为省去了激光雷达感知信息的融合过程。

而从人类驾驶的形式来看,也不需要雷达来辅助,所以在技术上只要拥有了足够强大的视觉感知能力,就可以实现高阶智驾,级别甚至可以达到L4级。

这使得原本专注L4级别的Robotaxi行业,也开始押注纯视觉方案。

10月11日,特斯拉发布的无人驾驶出租车Cybercab正是一款“不需要激光雷达做感知冗余”的L4级无人驾驶车辆。

尽管多家智驾科技公司曾向智驾网表示,视觉感知就是无人驾驶的终极解决方案,但激光雷达做为感知冗余配置在L4、L5级无人驾驶车辆上的配置在当前技术阶段依然是不可取代的。

但马斯克对于Robotaxi上能以纯视觉方案实现完全自动驾驶的路线非常有信心:“使用AI和计算视觉,不需要昂贵的设备,就可以在无监督的情况下实现FSD。”

而商汤绝影CEO王晓刚向智驾网表示:“在短短的这几年的时间里,自动驾驶软件的架构、技术路线发生了几次翻天覆地的变化。今天,这是一个行业发展趋势,在视觉智驾这一趋势到来的时候应该积极去拥抱新的变化。”

我们同意这种观点,虽说两种路线会有共存阶段,但是纯视觉智驾一定会成为下一个不可回避的必争风口。

评论