作者:韩雪

前段时间朋友圈出现了几段3D动物头像的小视频,那时笔者好奇地找了找这什么软件做的,哦Animoji——哦iPhone X——才知道这是个暗戳戳秀苹果新机的好手段嘛。

用户选择iPhoneX自带的不同表情包,动物、外星人甚至是大便等等角色,打开手机前置摄像自拍一段视频,麦克风同步记录声音,生成可爱的Animoji动画表情。最后用 iMessage与朋友分享这段Animoji表情,或者录制成视频发布到社交软件上,就低调地秀了一把iPhone X啦!

但Animoji可不只是这么一个小小的玩物……

图1 风靡朋友圈的Animoji

一、Animoji的重要元件——深感摄像

iPhoneX的谍照泄露时,谁也不会相信苹果真的会做出这样一款带着丑丑刘海的手机。不过里面的几样小细节却是iPhone X超越iPhone8的核心元件。

Infrared camera 红外摄像头:捕获红外图像中面部点阵数据。

Flood illuminator泛光感应元件:发射不可见红外光,让红外镜头顺利捕捉面部点阵图案。

Proximity Sensor 距离感应器:打电话时自动息屏,或防止手机被收纳起时被手势唤醒等。

Ambient light sensor 环境光传感器:根据环境光自动调节手机亮度和色温。

Dot project 点阵投影器:投射数量大于三万的光点,方便镜头捕获面部数据。

图2 iPhone X的黑色刘海

iPhone X的这款黑色刘海,搭载A11仿生神经元系统,组成了iPhone X的原深感摄像系统(True Depth camera system)。它的工作程序大致是这样:

点阵投影器将肉眼不可见的30000多个光点投影在人的面部,泛光感应元件发射出同样不可见的红外光线,配合光点,方便红外镜头读取点阵图案,捕捉红外图像。这一过程即使在黑暗中也可完成。最后数据被交给A11仿生神经元芯片进行处理。

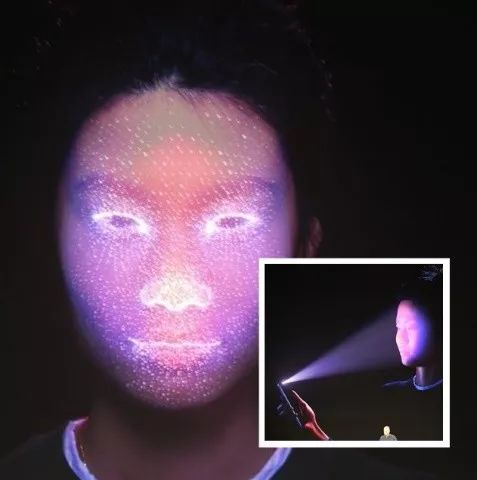

图3 超过三万光点构成了立体网格

值得注意的是,苹果的原深感摄像系统读取的并不是传统的2D平面数据,而是具有深度、完全立体的人体面部构造的3D模型数据;同时,超过三万的光点网格对面部的细部勾勒,使得还原后的人脸更加精细逼真。当面部表情发生变化时,原深感摄像系统也会实时追踪和提取变化的数据,及时录入。

因为是红外成像,用户所在环境的明暗不影响它的使用。但只支持读取一个人的面部数据,也就是说,iPhone X目前无法处理同时入镜的两个及多个的人物面部数据。

图4 iPhone X处理的是三维人脸

3D面部数据的庞大,对iPhone X的数据处理能力提出了更高的要求——iPhone X所配备的A11仿生神经元芯片拥有六个核心和 43 亿个晶体管,其中的神经网络引擎采用双核设计,每秒运算次数最高可达 6000 亿次,完全胜任对用户面部数据的读取、分析和重建,使得还原后的人体面部三维图像更加逼真流畅; 另外,用户面部随着时间推移而发生改变时,A11的机器学习技术使得 iPhone X能够自适应用户的面孔。

图5 《霍比特人2》中的面部和动作捕捉技术

用面部小点作为标记,帮助光学系统追踪面部和身体的动作变化,最终模拟三维动态效果——这种面部和动作捕捉系统,早就在电影中实现了。卷福在《霍比特人2》中扮演恶龙史矛革的这段,面部数据和动作信息的捕捉就是通过三维点阵完成的。苹果则是将这种面部数据的捕捉真正应用到了智能手机上,并且精确度极高。

图6 精密的3D人脸数据大大降低手机解锁失误率

基于原深感摄像系统的iPhone X实现了Face ID的面部识别功能——用户可以通过刷脸来解锁手机。原深感摄像系统会读取用户独一无二的3D脸部结构图,并将它与被保护在 A11 仿生安全隔区中的机主的3D面部数据进行对比,如果两者一致,iPhone X 便会解锁。

基于A11仿生神经元引擎的及其学习能力,即使是用户化妆活着留起胡须,iPhone X也可以迅速识别。出于安全考虑,苹果公司还增加了注视感知功能,只有用户在睁眼注视iPhone X的时候它才会解锁;在用户阅读手机内容时自动打开通知和信息,并保持屏幕常亮。苹果发布会上公布的Face ID失误率,是一百万分之一,相比指纹识别失误率的五万分之一,安全系数更高。

图7 Face ID惹争议

虽说曾有双胞胎可平滑解锁对方手机的测试,最近又出现了没有血缘关系的同事也可以解锁iPhone X怒而退货的事件,更有一家越南公司利用3D打印的硅胶面具成功骗过了iPhone X的人脸识别系统……这样看来,似乎人脸识别的技术还没有到达万无一失的地步,但相信未来技术发展必然会解决这个遗留问题。

二、Animoji的关键技术——AR

提起面部捕捉,就必须得提起苹果早些年的几次收购了,花大手笔买下了3D传感器制造商 PrimeSense、图像识别公司 Perceptio、增强现实公司Metaio和运动捕捉技术公司Faceshift。

其中,PrimeSense公司率先利用红外摄像捕捉投射在具体场景上的红外点格,并用一个经过特殊处理的芯片来计算红外点格的深度数据,完成了对原场景的3D处理。

图8 最初的AR技术

因而大发展到2017年,iPhoneX最终将这种增强现实技术(Augmented Reality也称AR技术)成功应用于量产的智能手机,也是自然而然。而且增强现实技术AR不像虚拟现实技术Virtual Reality(人称VR)一样受制于复杂的硬件设备而推进缓慢。AR的发展目前一直在加速。Animoji本身的成功应用就已经印证了AR技术的高速发展。

对此,也有用户质疑,Animoji究竟是不是iPhone X独有功能?因为有用户尝试盖上“刘海”上面的其他部分,只留下前置镜头,Animoji也一样工作;但是,如果盖上了前置镜头,它就会停止。

所以结论就是Animoji其实并不需要iPhone X黑色刘海里的所谓“重要原件”? iPhone 8配置Animoji和iPhone X配置的Animoji的效果没啥两样??

图9 Animoji中狐狸头像的动态效果

苹果对此做出了官方回应,整个红外光线面部标记的系统并不是全程处于开启状态。它是在在每次Animoji启用时,绘制分析和更新用户面部数据,然后使用前置摄像头实时跟踪用户的面部运动,并转化为相应的Animoji表情。

所以开启Animoji一会后再盖上“红外镜头”,当然可以继续使用啦,只是长此已久的动画效果会表现不佳。还有,相应的iPhone 8并未配置原深感摄像系统,也无法更精准地描绘和识别人脸,所以自然不会有iPhone X的体验

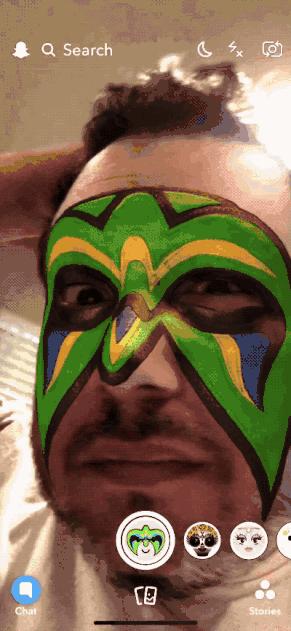

而iPhone X具有了领先的AR技术,自然比一般手机更加适应那些需要AR技术的软件。比如Snapchat的照片分享,之前一直有很受欢迎的面部匹配滤镜功能。苹果宣布与它建立合作伙伴关系后,Snapchat通过原深感摄像技术抓取到更加精准的用户面部数据,软件中的小贴纸也会根据3D面部数据进行调整和适应,表现的更加立体和流畅,而不是像普通手机那样呆板地贴在人脸上。

图10 iPhone X中使用Snapchat的效果

这里需要说明的一点是,iPhone X使用的AR技术不同于目前市面上的许多图像美化软件的技术。

女性用户一定记得被B612和FaceU刷屏的朋友圈照片,这两个软件主要是通过前置摄像头对人脸进行识别,添加一些表情和贴纸,如兔耳朵、墨镜或者一只小猫咪,完成对照片或者视频的实时美化;男性用户肯定知道游戏直播中常用的Face Rig,做工要更精细些。

总而言之,它们的技术基本立足于2D建模,依托简单的前置摄像头和平面图像,并没有iPhone X那么多的性能组件。比如FaceU在今年6月份推出的人脸表情制作工具,将用户的2D自拍画面转换为虚拟3D角色。但用户所扮演的虚拟角色的3D模型,其实是已经预设好的。

图11 大眼和吐彩虹的表情效果较为平面化

所以表现效果当然是比iPhone X要差。最明显的就是在处理人面部的动态贴纸上,基于普通手机的FaceU不能像Snapchat 的面部美化工具那样,对立体人脸进行自适应和调试,像面具一样紧密贴在人脸上。

基于iPhone X的原深感摄像系统,数以万计的红外光点组成面部的立体网格使得捕捉到的3D人脸数据更清晰立体, A11仿生神经元引擎的分析和重建3D模型更加精准,最终成像效果也就更生动逼真,表情动作也更加流畅。

图12 FaceU首页展示的脸部2D平面贴纸

FaceU所追求的一张照片速成3D图像,正是iPhone X所极力避免的。你的一张照片可以在FaceU里可以成型为你的立体面孔 ,但你的一张照片并不能解锁你的iPhone X。

另外,知名分析师郭明琪称苹果公司因原深感摄像技术的掣肘,已经打算放缓iPhone X的产量。不过这也不要紧,业内普遍认为安卓手机想要追上苹果的面部识别和捕捉技术,复刻相同的用户体验,同时攻克量产困难的问题,也还需要两年。

三、Animoji的开发工具——ARKit

不只是苹果在发展AR技术,游戏Pokémon Go中AR就已经得到了成功应用,Adobe公司也推出了Adobe Character Animator 和Realallusion’s Crazytalk这样的AR处理软件。Facebook的CEO扎克伯格还意图将AR作为Facebook十年发展计划的重中之重。

图13 介绍AR开发工具ARKit

苹果当然不甘示弱。在全球开发者大会上,苹果公布了iPhone和iPad开发AR应用的软件开发工具ARKit,方便开发者们为iOS设备开发出新的AR应用。开发者可以通过这个开发工具获取到做Animoji时所读取的人类面部网格数据。库克称它为“最大的AR平台”。

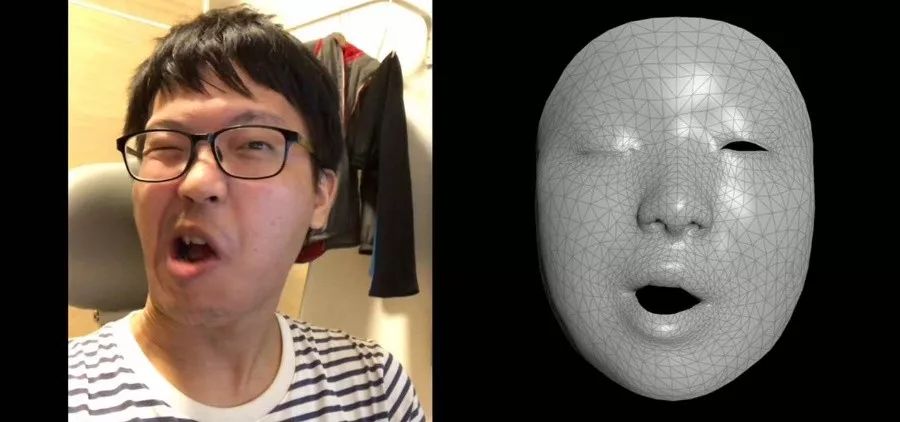

不光应用开发者可以用,其实普通用户也可以用以提取自己的面部数据。来自台湾的视觉特效专家Elisha Hung就用ARKit抓取了自己的面部数据,再利用Python和Houdini将其转化成一个常规可编辑的3D文件。虽然他的视频下方有一些关于怎么做的疑问,整个的制作过程也不甚明晰。但关键在于,他的作品演示说明iPhone X完全可以作为用户自己的表演抓取工具。

图14

图15 台湾的Elisha Hung抓取和分析面部数据

iPhone X黑色刘海上搭载的原深感摄像系统,并非什么突破性技术,但鉴于它对AR技术的成功应用和它所面向的庞大用户群体来说,无疑是一个强有力的“革命信号”——普通的手机用户不用像以往一样坐在电影院里,看AR技术做出的动态画面,只做一名被动观众。他们完全可以是AR技术的使用者,利用AR技术来设计出独一无二的角色。

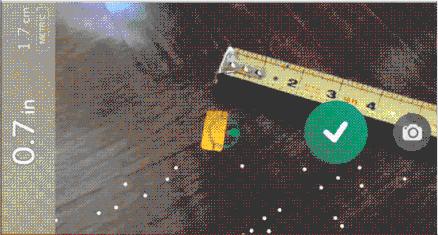

目前网络上利用Animoji重现经典电影片段的视频十分火爆,仅仅只是冰山一角,更多利用ARKit开发完成的新应用才刚刚登场。比如你可以让iPhone X教你跳舞,打开名为Dancing Reality应用,通过 iPhone 的屏幕投射出的脚印和步法勤加练习。你也可以用iPhone X作为测量工具,在没带尺子的时候打开名为AR Measure的应用,实地测量你需要的物件,准确度并不会比真正的测量工具差多少……

图16 AR测量工具

一个制作面部表情动画的Animoji,是AR技术一次成功的应用,也是ARKit平台的踏出的最初一步。它似乎预兆着一个全新AR时代的到来。

评论