文|侃科技

去年10月,谷歌在Google Cloud Next大会上发布了有关云技术未来三年的十大预测。

其中有一条堪称打工人的最爱:AI驱动的四天工作周。

谷歌解释,人工智能创新比如低代码、Vertex AI Vision和Translation Hub,将实现任务自动化,让团队能够在四天之内完成五天的工作。

那时ChatGPT还没有发布,也没有人想到微软会在谷歌的后院点火。

自去年12月至今,微软与OpenAI的合作已经到第三阶段,先后落地了整合ChatGPT技术的New Bing和Office,也将OpenAI技术捆绑到自家的低代码平台Power Platform。

总之,作为「卖铲人」,微软正在努力让它的铲子变得更聪明。

并且,开发者通过Azure直接调用OpenAI大模型的能力,更是一座肉眼可见的云计算富矿。

在最新的财报中,微软透露已经有200多个客户--从毕马威到半岛电视台--正在使用Azure OpenAI服务。

这不仅对微软来说是一个好消息,也乐坏了已经准备勒紧口袋过日子的北美云厂商。

2022年Q4业绩会上,Meta明确表示2023年的管理主题将会是「效率」,资本开支将更加关注成本效益;亚马逊AWS正与客户合作进行成本优化;微软表示除优先级决策外,其余支出增长将会非常缓慢。

而在ChatGPT出现之后,即使在行业需求放缓的背景下,它们也在积极的将投资重心转移至AI、新型数据中心架构等领域。

这虽然是一个投资未来的故事,但却对今年的云计算产业至关重要。

云厂商的日子不好过

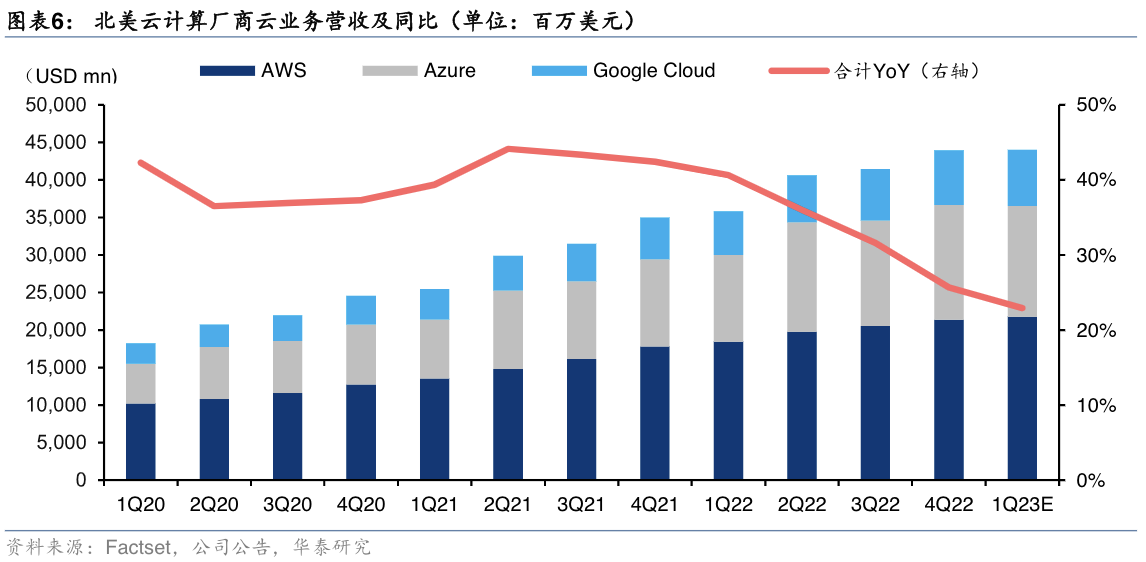

梳理亚马逊、谷歌、微软三家云厂商的财报发现,2022年Q4三家合计营收虽然同比增长25.7%至439.6亿美元,但环比却出现了5.9%的下降。

细分到每一家,亚马逊AWS、微软Azure、谷歌云营收同比增速分别为20.2%、31.0%和32.0%,环比下降为7.3%、4.0%和5.6%。

从2021年Q2开始,云厂商的营收增速就走下坡路了。

亚马逊CFO布莱恩·奥萨维斯基将原因归结为宏观经济低迷,客户对业务支出有优先级考量。举例来说,随着抵押贷款业务量的下降,相关金融公司对于计算存储、计算能力的需求也会相应下降。

言下之意,就是产业需求在消退,我们自然也就没有那么高的增速了,这样的后果即是云厂商在资本开支和人员结构上的收缩。

据Factset一致预期,2023年Q1亚马逊、谷歌、微软、苹果、Meta这五家的资本开支将出现4.13%的环比下降,同比增速较2022年下降15.24%。

研究机构TrendForce今年2月也发布预警,Meta、微软、谷歌、亚马逊这四家云厂商的服务器采购量可能从年增6.9%放缓至4.4%,这一举动将拖累2023年全球服务器出货量年增长率下滑至1.87%。

2022年Q4,亚马逊雇员人数自2018年以来首次同比负增长;2022年11月Meta裁员13%,人数超过10000人;今年1月18日,微软宣布计划到2023财年第三季度末裁员10000 人,约占员工总数的4.5%;两天后,谷歌母公司Alphabet宣布将在全球范围内裁员12000人,约占全职员工的6%。

然而这种勒紧口袋过日子的状态又很快被抵消,北美云厂商一边裁员优化资本开支,一边在紧锣密鼓的针对AI进行长期投资。

chatGPT浪潮带来的AI竞争,最直接的受益者正是云计算平台。

一方面,生成式AI应用背后的大模型需要更强的算力。OpenAI此前公布过一组数据,目前大模型训练所需算力的增速保持在3-4个月/倍速度增长,远超摩尔定律18-24个月/倍。

在ChatGPT被广泛运用的背景下,底层基础设施(IaaS)将迎来新一轮景气度上行,倒逼云厂商提高算力,从而满足海量数据调度的需求。

另一方面,区别于传统云计算平台提供的算力、存储等资源,拥有大模型的云厂商未来可以提供基于大模型开发应用。李彦宏不久前在接受采访时就抛出过类似的观点,未来企业在购买云计算的时候不看底层算力,而是看大模型的优劣。

大模型竞争激化

这也是为何有那么多公司如此重视ChatGPT:

英伟达CEO黄仁勋将ChatGPT视为人工智能领域的iPhone时刻;比尔盖茨将ChatGPT定义为自图形用户界面以来最重要的技术进步;李彦宏将大模型称之为云计算市场的game changer(颠覆者)。

事实上,在生成式AI众多的愿景中,云计算恐怕是当下离商业变现最近的一个。

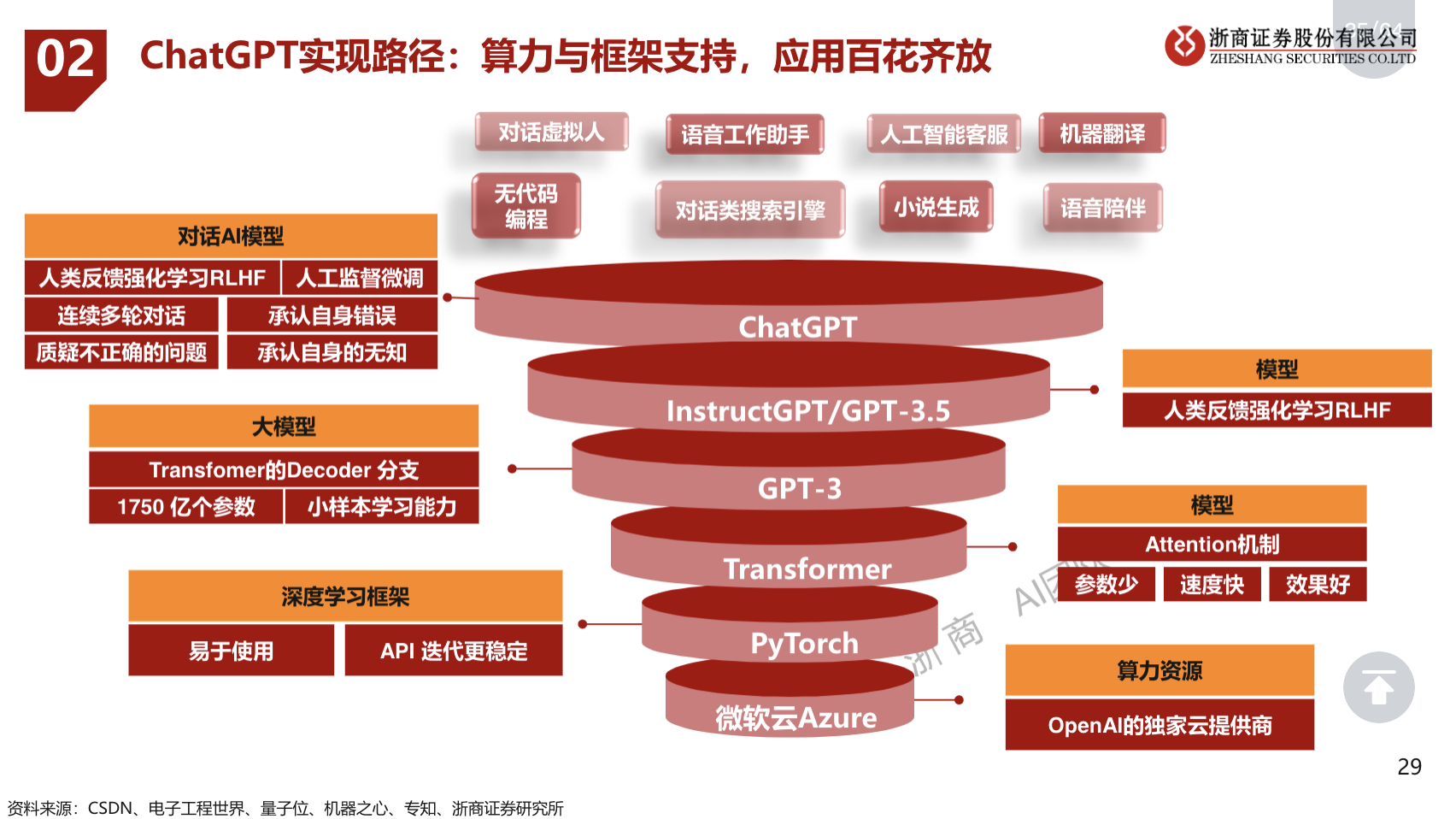

从ChatGPT的实现路径而来,云计算在最底层提供算力资源,服务上层的各种生成式AI应用程序。

这其中的想象力来自于,各种大模型以及chatGPT、文心一言等AI应用推出后,来自外部开发者对其能力的调用,尤其是一些中小开发者。

比如已经有公司将ChatGPT和文心一言能力融合到具体产品,开发出具有一站式AI创作环境的「AI编剧」。

通俗来说,ChatGPT是一个超级工具,连接和利用云厂商提供的底层资源,将资源变成产品,直接提供给企业。但在这个过程中,算力资源虽仍是基础设施,但对云厂商的要求就不只是算力的快慢,也有大模型的优劣。

对云厂商而言,有了大模型的加入和AI应用开发的浪潮,就会催生两个需求:

第一,以往云厂商售卖算力和存储空间,现在外部开发者可以直接调用云平台的大模型能力,在此基础上开发AI应用。这样的逻辑是,开发者可在不使用云计算平台的情况下,基于大模型开发应用。

但这个路径下,该应用在调用大模型能力时,仍会间接使用大模型所在的云平台资源。

对云厂商而言,上述逻辑的核心包括两个方面,其一是大模型能力,外部开发者无需自己开发大模型,直接调用;其二是云计算资源,ChatGPT等生成式AI背后的大模型,首次对算力展现出了极高的要求,任何想要在大模型领域分一杯羹的企业,都避不开其背后的云资源。

并且,上述情况在未来一段时间,尤其是chatGPT开放插件功能后,将会迎来一个AI应用的井喷,这种数量级的增长必然会引流到云计算平台,最后转化为真金白银。

所以,当有开发者喊出「这很像AI时代的安卓系统」时,就代表着云计算已进入一个至关重要的拐点时刻。

第二,对于云厂商来说,满足大模型训练而来的私有云服务需求,将会是一个新的增量市场。

在大模型训练前,往往对于模型所需的训练算力就会有一个初步的认知,并会提前针对所需算力进行准备与布局,不太可能存在模型训练中临时扩充大量算力的情况,这就使得公有云能够快速扩容的优点在大模型领域不复存在,私有云同样能够支撑起模型训练的算力需求。

公有云虽然在易用性方面有一定优势,但是这些服务具有较大的「绑定」特性,例如如果用户使用微软预训练的DNN进行图像处理,就不能轻易在自己的服务器上运行所产生的应用程序,同时用户也无法在非谷歌的公有云使用谷歌的TPU和AuoML工具。

而在目前大模型的训练当中,需要不断用新的数据和功能来保持它的「新鲜度」。由于私有云仅供单个组织使用,因此企业可以完全控制其软件和硬件选择,这种高度控制意味着私有云的所有者可以针对任务重新配置或定制云资源,进一步提高效率。

随着大模型变得越来越复杂,私有云能够提供更大范用和更洋细的规范,例如,插入特定应用程序并确保持续可用性和数据速度的自力。

并且,从开发者的角度出发,一方面,对于固定预训练的AI大模型需求,公有云布局和私有云布局的成本基本一致,由于没有快速扩容需求,公有云的规模成本优势将减弱;

另一方面,公有云的训练效率反而会低于专为自身AI训练所搭建的私有云,对于连续的、大规模深度学习而言,使用本地私有云反而可以节省大量成本,同时提高训练效率。

商业格局或将洗牌

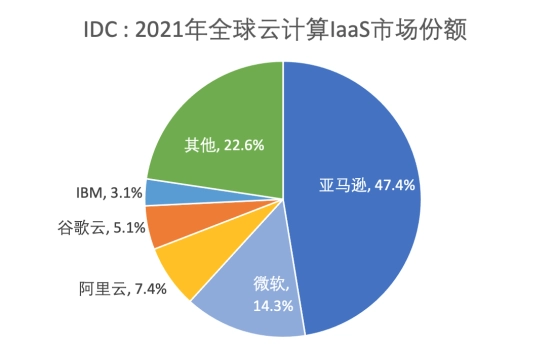

IDC统计的2021年云计算市场份额中,亚马逊、微软和阿里为市场前三,这样的格局已经持续了至少5年以上。并且其份额遥遥领先于追赶者,比如位列第四、第五名的谷歌、IBM,份额仅有亚马逊的1/9和1/15。

在中国市场,阿里、腾讯和华为保持着绝对的第一梯队。

这种近乎固化的市场格局,很大程度上源自于市场领导者的先发优势,更多的客户、数据中心和经验形成了企业壁垒,后来者很难打破。而且这些领导者也在持续创新,比如阿里、华为等向下延伸做硬件自研。

但同时,技术创新也为后来者提供了勇闯龙穴的武器,比如大模型。

相较自研硬件,大模型的影响力更大。一览科技联合创始人陈锡锡就表示,像微软云或百度云这样有大模型能力的云平台,对开发者或企业来说不仅是吸引,还会卡脖子,“不拥抱AI的企业很危险”。

大模型以及其背后的AI生态,将会彻底改变云计算的产业规则,因为它将会是一些新机会的诞生沃土。

在百度集团副总裁袁佛玉看来,上述产业机会至少会有三个方向:

一是新型云计算,云计算公司主要的商业模式会变成MaaS(Model as a Service),模型即服务;

二是行业模型精调,它是通用大模型和工业、金融、交通、能源、媒体等行业的中间层,将会有巨大的机会;

三是应用开发,可以类比为移动时代的微信、抖音、淘宝。

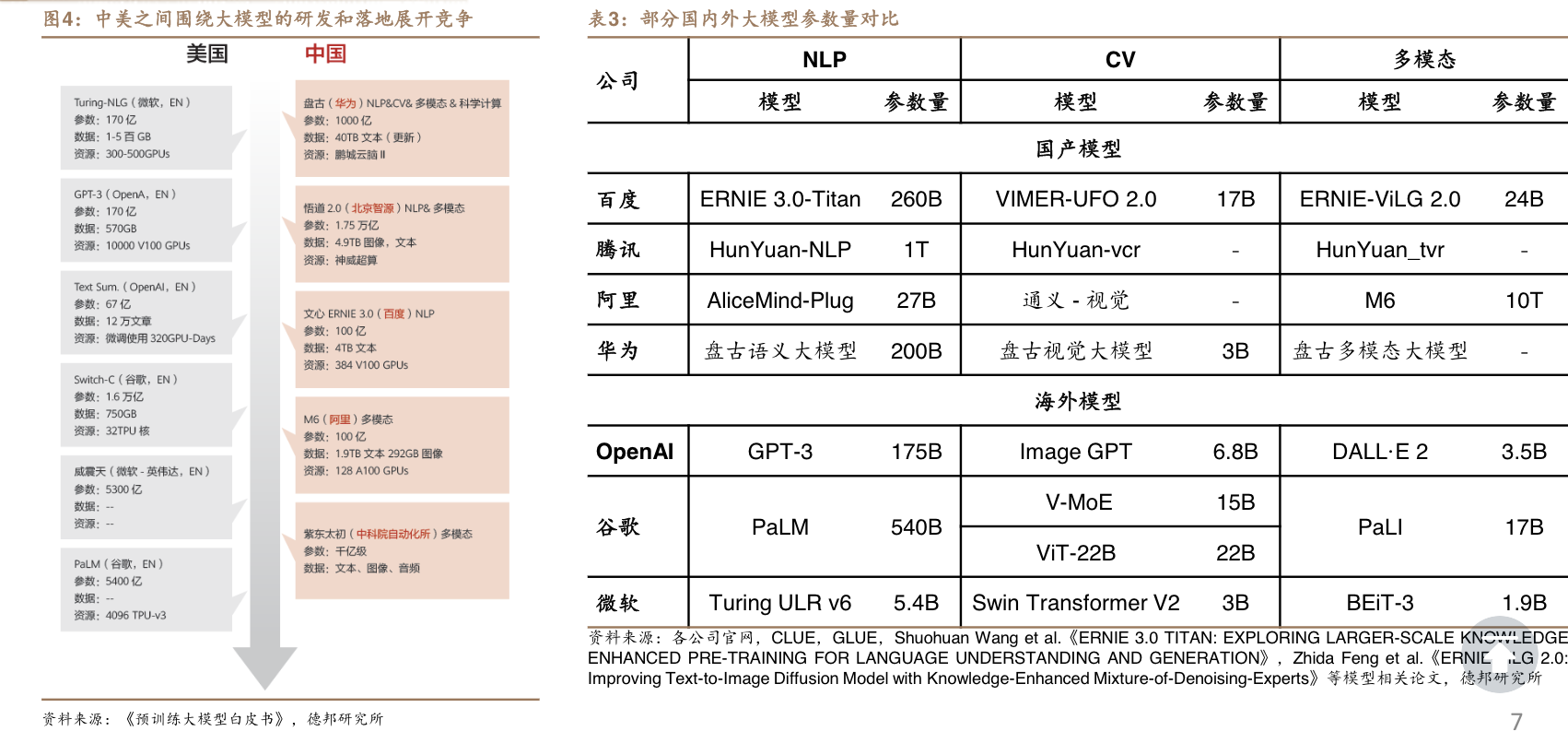

事实上,今天市场中,云厂商几乎都已经有了自己的大模型,并且中美之间已经围绕大模型展开研发和落地的竞争。

尾声

有人将OpenAI的联网化举动形容为「iOS App Store事件」,足以显示出AI时代靠近我们的速度多么的快。

而在背后支撑类chatGPT的云计算,也将在这场变革中扮演越发重要的角色。

不久前李彦宏在接受媒体采访时回答了这样一个问题:当您在描述全新的云计算生态出现的时候,未来的十年内会不会出现一个诞生新的微信、新的淘宝、新的抖音的机会?

李彦宏如此回答:肯定会,甚至诞生10倍于这些价值的机会。

参考资料

[1] 云计算:北美云厂商眼中的2023,华泰证券

[2] 计算机行业:ChatGPT研究框架,浙商证券

[3] 中国如何实现Zettascale计算, 华泰证券

[4] 私有云将成为AI大模型算力主流布局, 海通国际

[5] ChatGPT是云计算的iPhone时刻,光锥智能

[6] AIGC专题三:国内大模型概览,德邦证券

评论